Попытка заменить глубокий поиск в Интернете обращением только к нейросетям опасна для аналитиков и специалистов OSINT, потому что нейросети дают удобные, но непроверяемые и часто ошибочные «готовые ответы», лишая аналитика контроля над источниками и контекстом.

В конечном счете такой подход повышает риск скрытых ошибок, смещения выводов и манипуляции результатами проведенной Конкурентной разведки.

1. Неустранимые «галлюцинации» и ложная уверенность

Большие языковые модели генерируют текст по статистическим шаблонам, а не по проверенным фактам. С этим связана проблема «галлюцинаций» (т.е. убедительных, но ложных ответов), которая в настоящее время считается системным и до конца неразрешимым ограничением.

Особенно ярко с этим столкнулись юристы: нейросети уверенно генерируют судебные примеры и нормы законодательства, которых нет и никогда не было в реальности.

Нейросети часто подают вымышленные ими самими данные с высокой степенью языковой уверенности, из?за чего аналитик, особенно начинающий, недооценивает вероятность ошибки и перестает проверять ключевые утверждения.

2. Потеря прозрачности и «трассируемости» источников

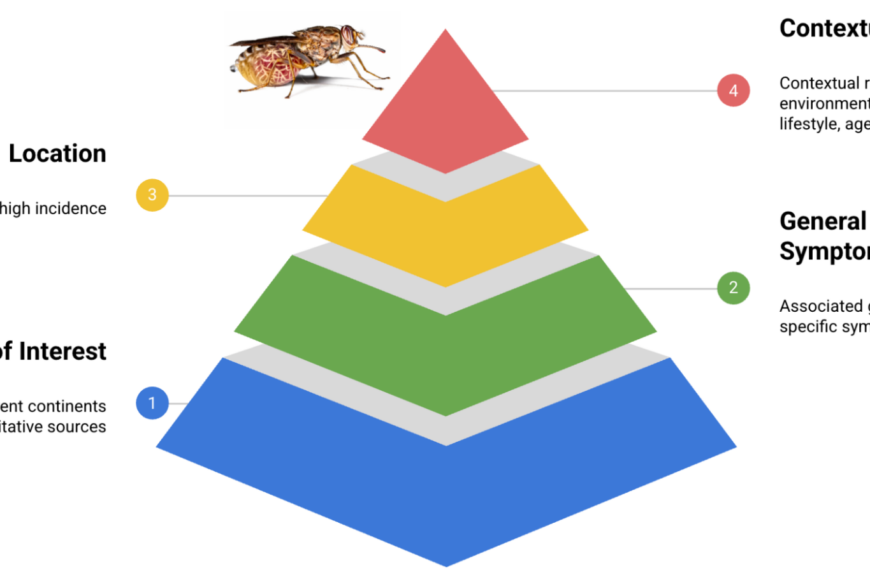

«Трассируемость» источников в аналитике и OSINT — это способность пройти «по следу» от любого утверждения в отчете назад — к конкретным исходным материалам: документам, постам, записям, датам, авторам и контексту (это очень важно!) их получения.

По сути, это применение идей traceability/data provenance к информации: фиксируется, откуда взялись данные, как они трансформировались и какие промежуточные шаги привели к финальному выводу, чтобы в любой момент можно было проверить надежность, воспроизвести выполненный анализ, и выявить возможные ошибки или искажения.

Определение «traceability» (Трассируемости, Прослеживаемости):

Traceability подразумевает способность проследить путь данных от исходного источника через все этапы обработки до конечного результата, фиксируя каждый шаг: создание, трансформации, перемещения и ответственных лиц. Это позволяет воспроизвести процесс анализа, выявить ошибки и подтвердить подлинность сведений.

Определение «Data provenance» (Происхождения данных):

Data provenance — это детальная историческая запись происхождения данных, включая метаданные о источниках, изменениях (кто, когда, как), зависимостях и процессах, чтобы гарантировать надежность и воспроизводимость. В отличие от линейного потока, provenance фокусируется на «родословной» каждого элемента, отвечая на вопросы, откуда данные, как они эволюционировали и почему они заслуживают доверия?

Классический OSINT опирается на явные ссылки, метаданные и возможность реконструировать цепочку: источник ? факт ? вывод, тогда как LLM обычно выдает синтезированный ответ без четко привязанных первоисточников.

Даже когда системы нейросетей добавляют «подсказки» с источниками, это требует дополнительного ручного перехода к материалам и (это важно!) не гарантирует, что все ключевые элементы вывода реально основаны именно на этих документах.

3. Усиление предвзятости и сужение поля зрения

Поскольку модели обучаются на веб-контенте, они унаследуют и усиливают существующие информационные и идеологические перекосы, а затем упаковывают их в один «правдоподобный» нарратив.?

Синтезированный единый ответ уменьшает разнообразие точек зрения и затрудняет аналитикам сопоставление альтернативных интерпретаций и выявление «слабых сигналов» в информационном шуме.

4. Ограничения работы с большим и сложным контекстом

Исследования указывают, что по мере роста длины контекста модели начинают хуже использовать удаленные фрагменты текста и «теряют» важные детали в длинных документах.?

Реальные OSINT?задачи требуют навигации по огромным распределенным массивам данных, которые физически не помещаются в контекст одной модели и требуют специализированных поисковых, и аналитических инструментов, а не только генерации текстов.

5. Риски безопасности, доверия и манипуляций

Правительства и эксперты по безопасности предупреждают, что генеративный ИИ ускоряет производство дезинформации, фейковых новостей и синтетических медиа, что размывает доверие к информационной среде.?

При отсутствии строгого контроля качества и валидации аналитики рискуют включать в отчеты ИИ?сконструированные «факты», неотличимые по форме от реальных, что может привести к неверным решениям в кибербезопасности, политике или правоприменении.

6. Чем полезны LLM и где проходит граница их полезности

Англоязычные обзоры по OSINT отмечают, что LLM хорошо помогают как вспомогательный инструмент: формировать сложные поисковые запросы (Google dorks — но для этого всё же надо иметь представление и опыт о том, как дорки работают «в ручном режиме»), черновые гипотезы и черновую структуризацию данных, но не заменяют поисковые и аналитические системы.?

Без независимого глубокого поиска, верификации источников и человеческого критического анализа использование нейросетей превращает разведку из аналитики в красивую, но потенциально опасную текстовую симуляцию анализа.

Евгений Ющук

Источник: yushchuk.ru

Источник: ai-news.ru