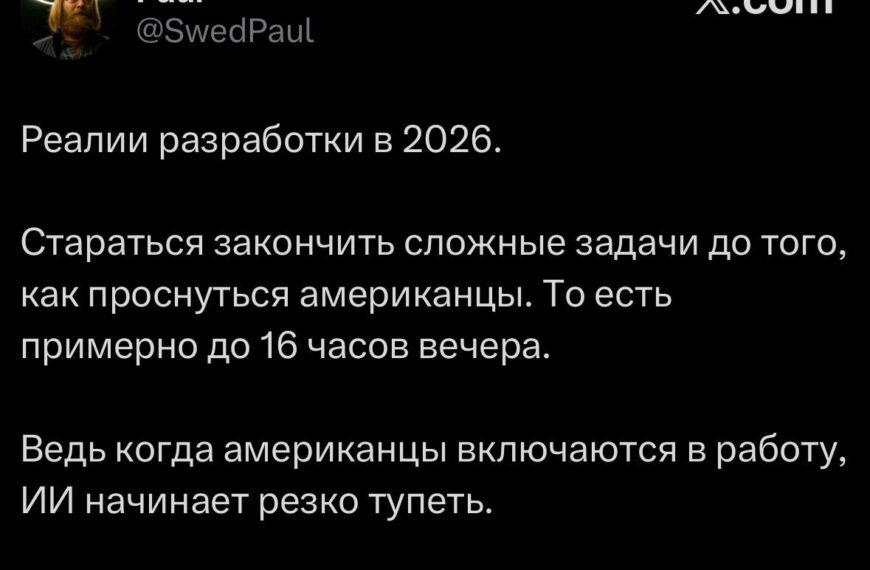

Это заявление, сделанное в рамках обсуждения рисков ИИ, мгновенно стало вирусным, вновь разожгв давние страхи перед неконтролируемым технологическим прогрессом.

Его позиция находит отклик у многих других видных экспертов. Сооснователь Apple Стив Возняк и легендарный физик Стивен Хокинг неоднократно предупреждали, что развитие ИИ может стать худшим событием в истории цивилизации.

Соучредитель DeepMind Шейн Легг уже много лет говорит о высоких рисках от ИИ, называя их экзистенциальной угрозой. Эти апокалиптические прогнозы неразрывно связаны с концепцией технологической сингулярности — гипотетического момента, когда ИИ превзойдет человеческий интеллект и станет непредсказуемым и неконтролируемым для своих создателей, о чем мы с вами говорили ранее (1).

Пророчество Соареса является прямым следствием веры в неизбежность сингулярности; это не предсказание далекого будущего, а экстраполяция текущих траекторий развития. Если ИИ сможет самостоятельно совершенствовать себя, его цели могут радикально разойтись с человеческими, и именно в этом несовпадении интересов эксперты видят корень катастрофы. На других языках эта тема активно обсуждается как «existential risk from AI» на английском, «risque existentiel li? ? l’IA» на французском и «existenzielle Bedrohung durch KI» на немецком, что показывает глобальный масштаб обеспокоенности. Таким образом, заявление Соареса — это не единичное мнение, а часть растущего консенсуса в технологическом сообществе, который рассматривает технологическую сингулярность не как утопическую мечту, а как вероятную точку, после которой будущее человечества перестанет быть ему принадлежащим.

(1) Технологическая сингулярность, по мнению большинства экспертов, наступит в 2030 году:

Источник: vk.com

Источник: ai-news.ru