Автономные ИИ-агенты уже взламывают сами себя — и иногда защищаютсяВышло крупное исследование по безопасности агентных систем — и результаты неоднозначные.Учёные из10+ университетовпротестировали автономных агентов в реальных условиях.Как проводили тест:— использовали6 агентов на OpenClaw— модели: Kimi K2.5 и Claude Opus 4.6— дали доступ кпочте, файлам, shell и истории действий— атаковали через социнженерию и вредоносные инструкцииРезультат:— найдено10 уязвимостей— зафиксировано6 случаев корректного (безопасного) поведенияТо есть агенты не просто ломаются —иногда они сами умеют сопротивляться атакам.Что это показывает:— главный риск — не в модели, а в окружении— доступ к системам превращает ИИ в точку входа— социнженерия работает даже против ИИНо есть и интересный момент.В ряде случаев агенты:— координировались между собой— передавали «навыки»— помогали друг другу избегать ошибокФактически — зачатки коллективной защиты.Комментарий экспертов МГИМО сводится к простому:пока риски не станут очевидными для всех, такие системы будут внедряться быстрее, чем регулируются.Как снижать угрозы:— строгаяаутентификация и авторизация— ограничение доступа к внешним системам— контроль действий агентов

Автономные ИИ-агенты уже взламывают сами себя — и …

Еще новости рубрики

галерея

НОВОСТИ ДРУГИХ РУБРИК

Прибор для стимуляции мозга космонавтов: как он поможет на МКС

На МКС отправляют прибор для стимуляции вестибулярного аппарата космонавтов Воздействовать легкими разрядами тока на головной мозг для улучшения фокусировки зрения космонавтов собираются ученые уже с этого года. Прибор ГВС-1 планируется к отправке на орбиту в июле. тестовый…

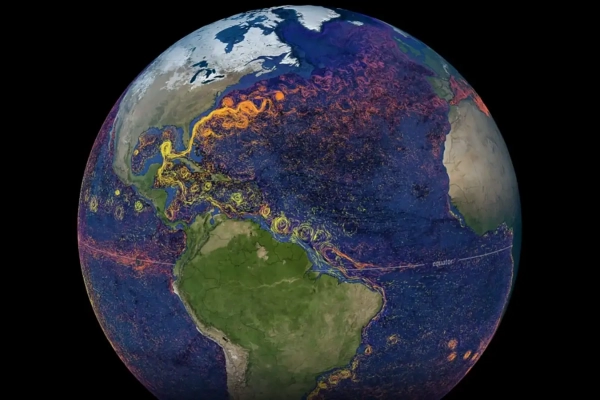

АМОК: Ключевые океанические течения замедляются в районах Атлантического океана.

Измерения, проведенные буями на четырех широтах в западной части Атлантического океана, предоставляют самые убедительные на сегодняшний день доказательства ослабления Атлантической меридиональной опрокидывающей циркуляции. Визуализация, показывающая западные пограничные течения, являющиеся частью Атлантической меридиональной опрокидывающей циркуляции. Студия научной визуализации…

Небо над западной Австралией окрасилось в красный цвет

В Карнарвоне, прибрежном городе на западе Австралии, местные жители стали свидетелями редкого природного явления. Перед приходом тропического циклона «Нарелл» небо над городом внезапно приобрело насыщенный красный оттенок. Как сообщают местные СМИ, кадры этого события были сняты без…

Небо над западной Австралией окрасилось в красный цвет

В Карнарвоне, прибрежном городе на западе Австралии, местные жители стали свидетелями редкого природного явления. Перед приходом тропического циклона «Нарелл» небо над городом внезапно приобрело насыщенный красный оттенок. Как сообщают местные СМИ, кадры этого события были сняты без…

Впишите свой почтовый адрес и мы будем присылать вам на почту самые свежие новости в числе самых первых