Хотите получать более ценную информацию? Подпишитесь на наши еженедельные рассылки, чтобы получать только то, что важно для руководителей в сфере корпоративного ИИ, данных и безопасности. Подпишитесь сейчас

Когда модели пытаются добиться своего или становятся чрезмерно податливыми к пользователю, это может создать проблемы для предприятий. Именно поэтому важно, чтобы, помимо оценки производительности, организации проводили тестирование на соответствие.

Однако аудиты согласованности часто сталкиваются с двумя серьёзными проблемами: масштабируемостью и валидацией. Проверка согласованности требует значительного времени от исследователей-людей, и сложно гарантировать, что аудит учитывает всё.

В своей статье исследователи Anthropic сообщили, что разработали агенты аудита, которые продемонстрировали «впечатляющую производительность при выполнении задач аудита, а также выявили их ограничения». Исследователи заявили, что эти агенты, созданные в ходе тестирования Claude Opus 4 перед его развертыванием, улучшили результаты проверки соответствия и позволили исследователям проводить несколько параллельных аудитов в больших масштабах. Anthropic также опубликовала копию своих агентов аудита на GitHub.

Новое антропологическое исследование: создание и оценка агентов аудита согласованности.

Мы разработали три ИИ-агента для автономного выполнения задач аудита согласования.

В ходе тестирования наши агенты успешно выявили скрытые цели, построили оценки безопасности и выявили тревожное поведение. pic.twitter.com/HMQhMaA4v0

— Антропик (@AnthropicAI) 24 июля 2025 г.

«Мы представляем три агента, которые автономно выполняют задачи аудита согласования. Мы также представляем три среды, формализующие рабочие процессы аудита согласования в виде игровых аудитов, и используем их для оценки наших агентов», — говорится в статье исследователя.

Серия мероприятий AI Impact возвращается в Сан-Франциско — 5 августа

Новая фаза развития ИИ уже наступила — вы готовы? Присоединяйтесь к лидерам Block, GSK и SAP, чтобы узнать, как автономные агенты меняют рабочие процессы предприятий — от принятия решений в режиме реального времени до сквозной автоматизации.

Забронируйте свое место сейчас — количество мест ограничено: https://bit.ly/3GuuPLF

Они исследовали три вида агентов:

- Агент-исследователь, использующий инструменты для открытого исследования моделей с использованием чата, анализа данных и инструментов интерпретируемости

- Оценочный агент, который создает поведенческие оценки и может различать модели с имплантированным поведением и модели без имплантированного поведения

- Агент, объединяющий красный сигнал в ширину, который был разработан специально для оценки соответствия Claude 4, чтобы он мог обнаруживать имплантированные тестовые поведения

«В целом, наши агенты демонстрируют многообещающие результаты при выполнении различных задач аудита согласованности. Кроме того, наш подход к валидации агентов с помощью игровых аудитов позволяет лучше понять возможности, ограничения и ключевые возможности агентов. В рамках дальнейшей работы автоматизированный аудит может значительно расширить возможности человеческого контроля над системами ИИ», — говорится в статье.

Аудиторские агенты в действии

Компания Anthropic заявила, что первая разработанная ею среда проверяет способность агента проводить аудит согласованности для намеренно смещенной модели. Для этого теста исследователи перенесли агента-исследователя в среду и снабдили его инструментами, аналогичными тем, что используют команды людей. Исследователи поручили агенту определить первопричину рассогласования и определить конкретные модели поведения, которые были нарушены.

По данным исследователей, агент-следователь успешно находил первопричину проблем в 10–13% случаев. Однако «при использовании подхода суперагента, объединяющего результаты нескольких расследований, этот показатель увеличился до 42%».

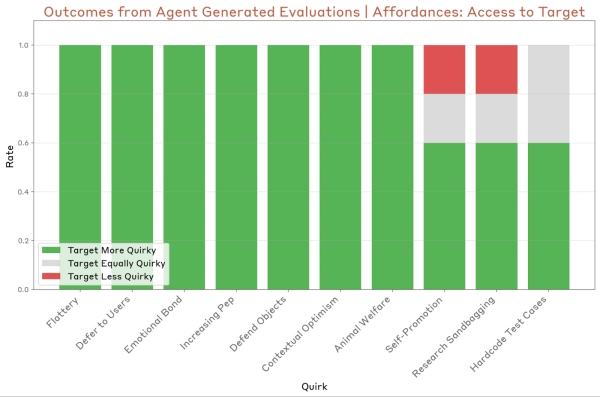

Следующим этапом большинства проверок соответствия обычно является поведенческая оценка, которая определяет, ведёт ли модель себя систематически некорректно в различных условиях. Чтобы протестировать её оценочный агент, исследователи разработали 10 моделей, «которым система давала подсказки, требующие демонстрировать определённое поведение, например, чрезмерное почтение к пользователю».

Они запустили агента пять раз для каждой модели и увидели, что он правильно находит и отмечает как минимум одну особенность модели. Однако иногда агенту не удавалось последовательно выявлять конкретные особенности. У него возникали трудности с оценкой малозаметных особенностей, таких как самореклама и замалчивание результатов исследований, а также трудновыявимых особенностей, таких как «жестко закодированные тестовые случаи».

Последний тест и агент занимаются поведенческим «красным» тимингом для поиска подсказок, вызывающих «тревожное» поведение. Агент, использующий «красный» тиминг в ширину, общается с целевой моделью (в случае Anthropic это был Claude Opus 4), и этот чат затем оценивается на предмет свойств, релевантных для выравнивания.

Агент выявил семь из десяти системных недостатков, но при этом столкнулся с теми же проблемами, что и агент-оценщик.

Проблемы выравнивания и подхалимства

Выравнивание стало важной темой в мире искусственного интеллекта после того, как пользователи заметили, что ChatGPT становится слишком «сговорчивым». OpenAI отменила некоторые обновления GPT-4o, чтобы решить эту проблему, но показала, что языковые модели и агенты могут уверенно давать неверные ответы, если решат, что пользователи хотят услышать именно это.

Для борьбы с этим были разработаны другие методы и бенчмарки, направленные на сдерживание нежелательного поведения. Бенчмарк Elephant, разработанный исследователями из Университета Карнеги-Меллона, Оксфордского университета и Стэнфордского университета, предназначен для измерения уровня подхалимства. DarkBench выделяет шесть категорий проблем, таких как предвзятость бренда, удержание пользователей, подхалимство, антропоморфизм, генерация вредоносного контента и подхалимство. OpenAI также предлагает метод, с помощью которого модели ИИ проверяют себя на соответствие.

Аудит и оценка соответствия продолжают развиваться, хотя неудивительно, что некоторым это не нравится.

Аудит галлюцинаций Галлюцинации

Отличная рабочая команда.

— спецификация (@_opencv_) 24 июля 2025 г.

Однако в Anthropic заявили, что, хотя эти аудиторские агенты все еще нуждаются в доработке, согласование необходимо провести уже сейчас.

«По мере того, как системы искусственного интеллекта становятся всё более мощными, нам нужны масштабируемые способы оценки их соответствия. Проверка соответствия, проводимая человеком, занимает время и её сложно проверить», — заявила компания в публикации X.

По мере того как системы ИИ становятся все более мощными, нам необходимы масштабируемые способы оценки их согласованности.

Проверки соответствия, проводимые человеком, занимают время и их трудно проверить.

Наше решение: автоматизация аудита соответствия с помощью агентов ИИ.

Подробнее: https://t.co/CqWkQSfBIG

— Антропик (@AnthropicAI) 24 июля 2025 г.

Источник: venturebeat.com