В новом интервью Андрей Карпаты рассказал, почему современные языковые модели не учатся как люди — и почему нас ждёт медленная, но неизбежная потеря контроля.

Он считает, что обучение с подкреплением и это тупиковый путь: модели не думают, а просто копируют и повторяют.

«Reinforcement learning ужасен. Просто всё, что было до него, ещё хуже.»

Карпаты отмечает, что люди учатся, создавая собственные данные — размышляя, связывая новое со старым, делая выводы. LLM этого не умеют, они просто запоминают.

Главное, по его словам, впереди — не сингулярность, а тихое делегирование мышления алгоритмам.

«ИИ лишит человечество возможности принимать решения. Мы перестанем думать и выбирать сами.»

Карпати считает, что нынешние агенты — «полное г…», а настоящего AGI стоит ждать не раньше чем через 10 лет.

Он боится не бунта машин, а того, что люди незаметно перестанут быть разумными — просто передав все решения системам, которые “знают лучше”.

Полное интервью (https://www.youtube.com/watch?v=lXUZvyajciY)

Epoch AI: даже GPT-5 не дотягивает до 70 % по уровню математического интеллекта

Исследователи из Epoch AI проверили, насколько современные модели действительно умеют «думать» в математике.

Они использовали тест FrontierMath — 290 задач, которые требуют не запоминания формул, а настоящего рассуждения и способности к обобщению.

Результаты оказались отрезвляющими.

Даже GPT-5, одна из самых мощных моделей на сегодня, смогла решить только 29 % задач в одном прогоне.

После 32 запусков (чтобы компенсировать случайность) показатель вырос до 46 %, но затем перестал расти.

Даже если объединить результаты десятков моделей — от ChatGPT Agent и Gemini 2.5 Deep Think до o4-mini, совокупная решаемость достигает лишь 57 %.

По оценкам авторов, даже при бесконечных попытках предел будет меньше 70 %.

Итог: несмотря на огромный прогресс, современные LLM остаются далеки от настоящего «AGI» — они всё ещё плохо справляются с глубинным рассуждением и гибким решением задач, где нужно не память, а мышление.

У современных LLM прогрессирует Brain Rot: обучение на мусорных данных вызывает деградацию интеллекта

Исследователи сообщили о тревожном эффекте — у больших языковых моделей (LLM) может развиваться “Brain Rot”, то есть постепенное «когнитивное разложение».

Причина — постоянное дообучение на низкокачественных и “вирусных” текстах из интернета, что приводит к стойкому снижению способностей к рассуждению, работе с длинным контекстом и безопасному поведению.

Главный симптом — “отсутствие мышления” (thought-skipping): модель перестаёт рассуждать шаг за шагом и начинает выдавать поверхностные ответы, а в некоторых случаях даже приобретает “тёмные” черты личности — нарциссизм, агрессию и низкую склонность к сотрудничеству.

Даже сильные методы коррекции, лишь частично устраняют последствия, что делает отбор обучающих данных ключевым фактором безопасности при развитии ИИ.

openreview (https://openreview.net/pdf/83a65493325365e136afa2dcb3f3910466b0ffde.pdf)

FacebookResearch представили MobileLLM-Pro — мощную языковую модель для работы на девайсах

Это компактная языковая модель (~1 млрд параметров) и несмотря на размер, она превосходит Gemma 3 1B и Llama 3.2 1B в задачах рассуждения, знаний и работы с длинным контекстом — до 128 000 токенов.

Внутри гибридное внимание (локальное + глобальное в соотношении 3:1, окно 512) это низкую задержку и экономию KV-памяти.

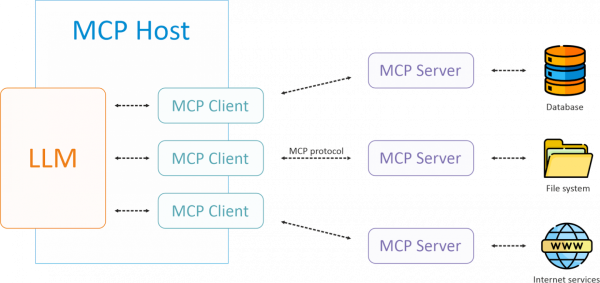

HuggingChat v2 — целый оркестр из 115 моделей под одной крышой.

Инструмент, в который встроено более 100 опенсорсных моделей от ведущих разработчиков.

Внутри: модели от OpenAI, Qwen, Google, Nvidia, DeepSeek и десятков других. Система сама выбирает оптимальную модель под конкретный запрос.

Попробовать (https://huggingface.co/chat/)

Источник: huggingface.co

Источник: ai-news.ru