Мы представляем первую в своем роде демонстрацию многомодального диалогового диагностического ИИ-агента — многомодального AMIE.

Быстрые ссылки

- Бумага

- Делиться

Системы искусственного интеллекта на основе языковых моделей, такие как Articulate Medical Intelligence Explorer (AMIE, наш исследовательский диагностический разговорный ИИ-агент, недавно опубликованный в журнале Nature), показали значительные перспективы для проведения текстовых медицинских диагностических бесед, но критически важный аспект интеграции мультимодальных данных в эти диалоги остается неизученным. Платформы мгновенного обмена сообщениями являются популярным инструментом коммуникации, позволяющим обогащать обсуждения статической мультимодальной информацией (например, изображениями и документами), и их использование также отмечалось в медицинской практике. Эта возможность обсуждать мультимодальную информацию особенно актуальна в медицине, где исследования и анализы необходимы для эффективного лечения и могут существенно повлиять на ход консультации. Поэтому вопрос о том, могут ли языковые модели проводить диагностические клинические беседы, включающие этот более сложный тип информации, является важной областью исследований.

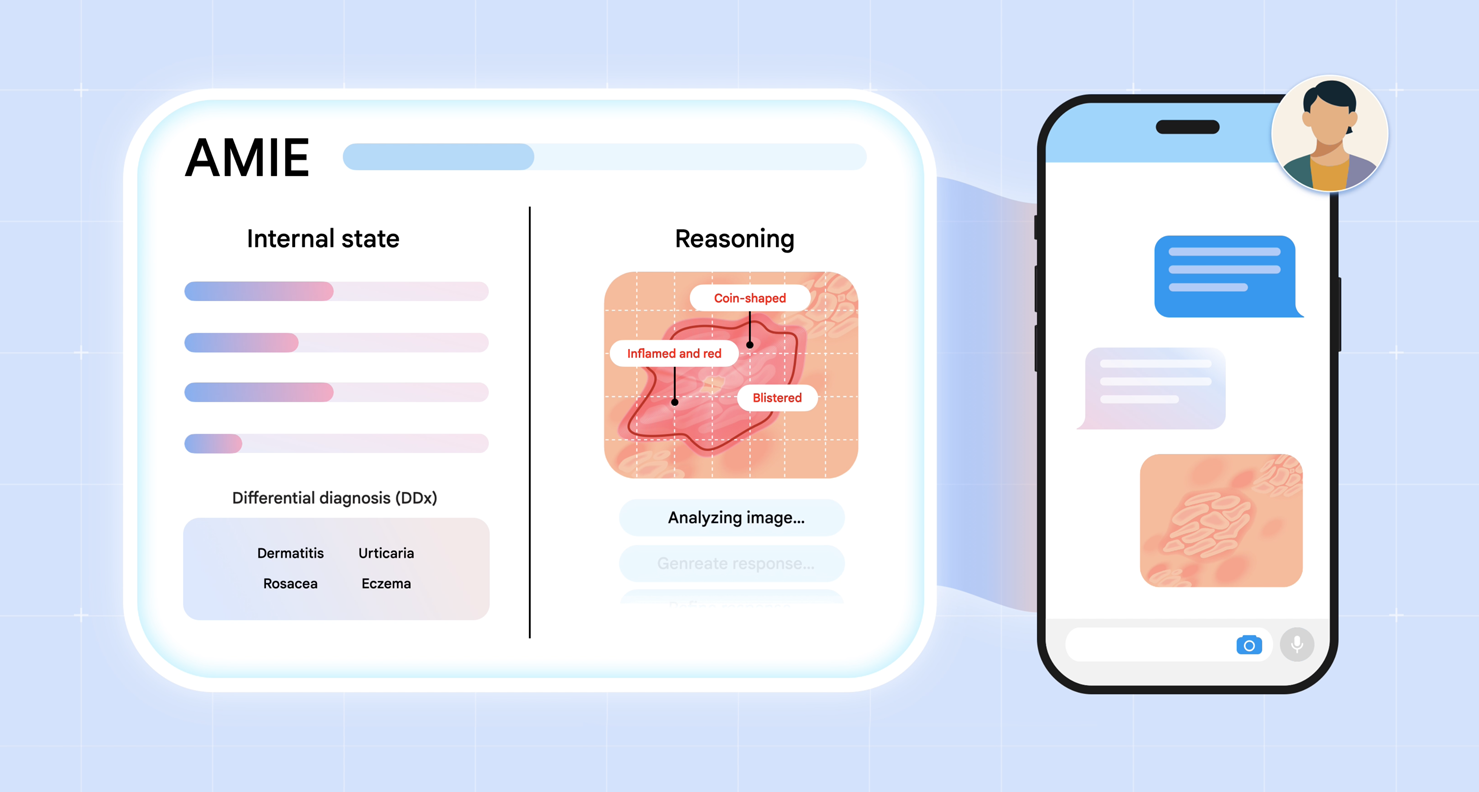

В нашей новой работе мы развиваем AMIE, добавляя возможность интеллектуального запроса, интерпретации и анализа визуальной медицинской информации в ходе клинического разговора, что способствует постановке точного диагноза и разработке планов лечения. Для этого, используя в качестве основного компонента мультимодальную систему Gemini 2.0 Flash, мы разработали агентную систему, которая оптимизирует свои ответы в зависимости от фазы разговора и возрастающей неопределенности в отношении основного диагноза. В результате получился процесс сбора анамнеза, лучше имитирующий структуру сбора анамнеза, распространенную в реальной клинической практике.

В ходе экспертной оценки, адаптированной к объективным структурированным клиническим экзаменам (OSCE), стандартизированной системе оценки, используемой во всем мире в медицинском образовании, мы сравнили эффективность AMIE с работой врачей первичной медицинской помощи (PCP) и оценили ее поведение в ряде мультимодальных сценариев с пациентами. Кроме того, предварительные эксперименты с Gemini 2.5 Flash указывают на возможность дальнейшего улучшения AMIE за счет интеграции новейшей базовой модели.

воспроизведение видео без звука зацикливание пауза видео без звука зацикливание включение звука видео выключение звука

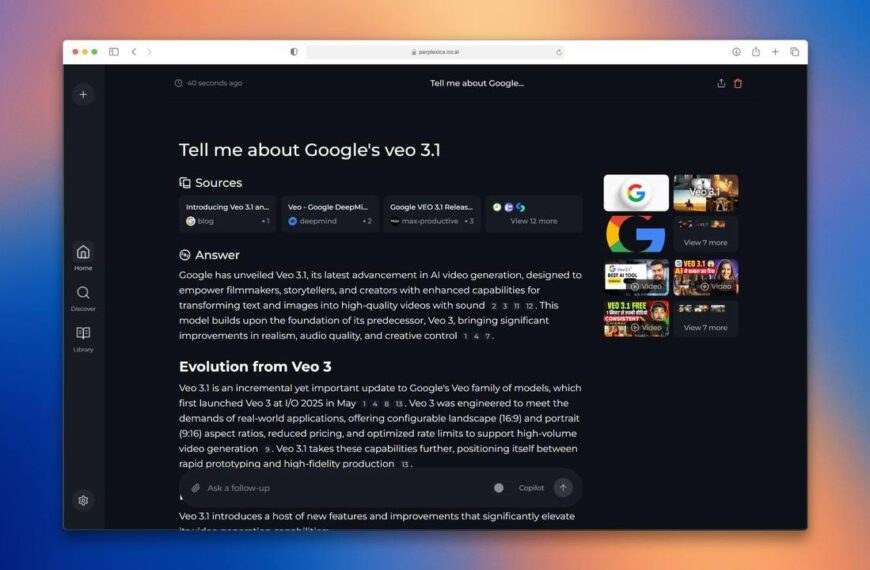

Мы представляем многомодальную AMIE : наш диагностический разговорный ИИ, способный интеллектуально запрашивать, интерпретировать и анализировать визуальную медицинскую информацию во время клинического диагностического разговора. Мы интегрируем многомодальное восприятие и рассуждения в AMIE за счет сочетания изначально многомодальных моделей Gemini и нашей системы рассуждений, учитывающей состояние системы.

Развитие AMIE для многомодального мышления

Мы представляем два ключевых усовершенствования системы AMIE. Во-первых, мы разработали многомодальную, учитывающую состояние систему рассуждений. Это позволяет AMIE адаптировать свои ответы на основе своего внутреннего состояния, которое отражает ее знания о пациенте в данный момент разговора, и эффективно и результативно собирать информацию для постановки соответствующих диагнозов (например, запрашивать многомодальную информацию, такую как фотографии кожи, для устранения любых пробелов в знаниях). Во-вторых, для обоснования ключевых проектных решений в системе AMIE мы создали среду моделирования для оценки диалога, в которой AMIE общается с смоделированными пациентами на основе многомодальных сценариев, базирующихся на реальных наборах данных, таких как набор данных SCIN с дерматологическими изображениями.

Имитация сбора анамнеза опытными врачами: рассуждения, учитывающие состояние пациента.

Реальные клинические диагностические диалоги следуют структурированному, но гибкому пути. Врачи методично собирают информацию, формируя потенциальные диагнозы. Они могут стратегически запрашивать и интерпретировать дополнительные сведения из широкого спектра мультимодальных данных (например, фотографии кожи, результаты лабораторных анализов или измерения ЭКГ). В свете таких новых данных они могут задавать соответствующие уточняющие вопросы, чтобы устранить пробелы в информации и определить возможные диагнозы.

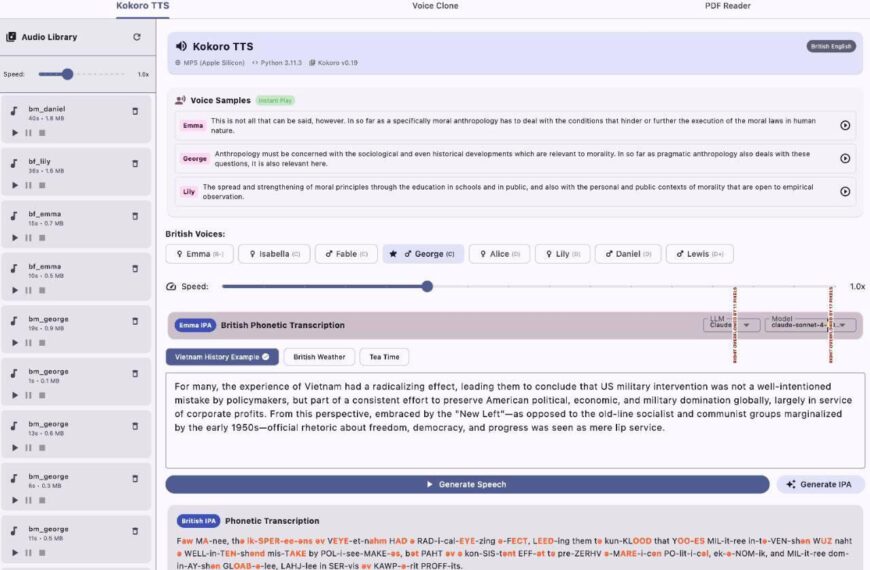

Для обеспечения AMIE аналогичными возможностями диалога мы представляем новую структуру фазовых переходов с учетом состояния, которая управляет потоком разговора. Используя Gemini 2.0 Flash, эта структура динамически адаптирует ответы AMIE на основе промежуточных результатов модели, отражающих изменяющееся состояние пациента, диагностические гипотезы и неопределенность. Это позволяет AMIE запрашивать необходимые мультимодальные артефакты, точно интерпретировать их результаты, беспрепятственно интегрировать эту информацию в текущий диалог и использовать ее для уточнения диагнозов и направления дальнейших вопросов. Это имитирует структурированный, адаптивный процесс рассуждения, используемый опытными клиницистами.

AMIE использует диалоговую структуру, учитывающую состояние пациента, которая проходит три отдельных этапа, каждый из которых имеет четкую цель: сбор анамнеза, диагностика и лечение, а также последующее наблюдение. Динамическое внутреннее состояние AMIE, отражающее ее развивающееся понимание пациента, диагнозов и пробелов в знаниях, определяет ее действия на каждом этапе (например, сбор информации и предоставление объяснений пациенту). Переходы между этапами запускаются, когда система оценивает, что цели текущего этапа достигнуты.

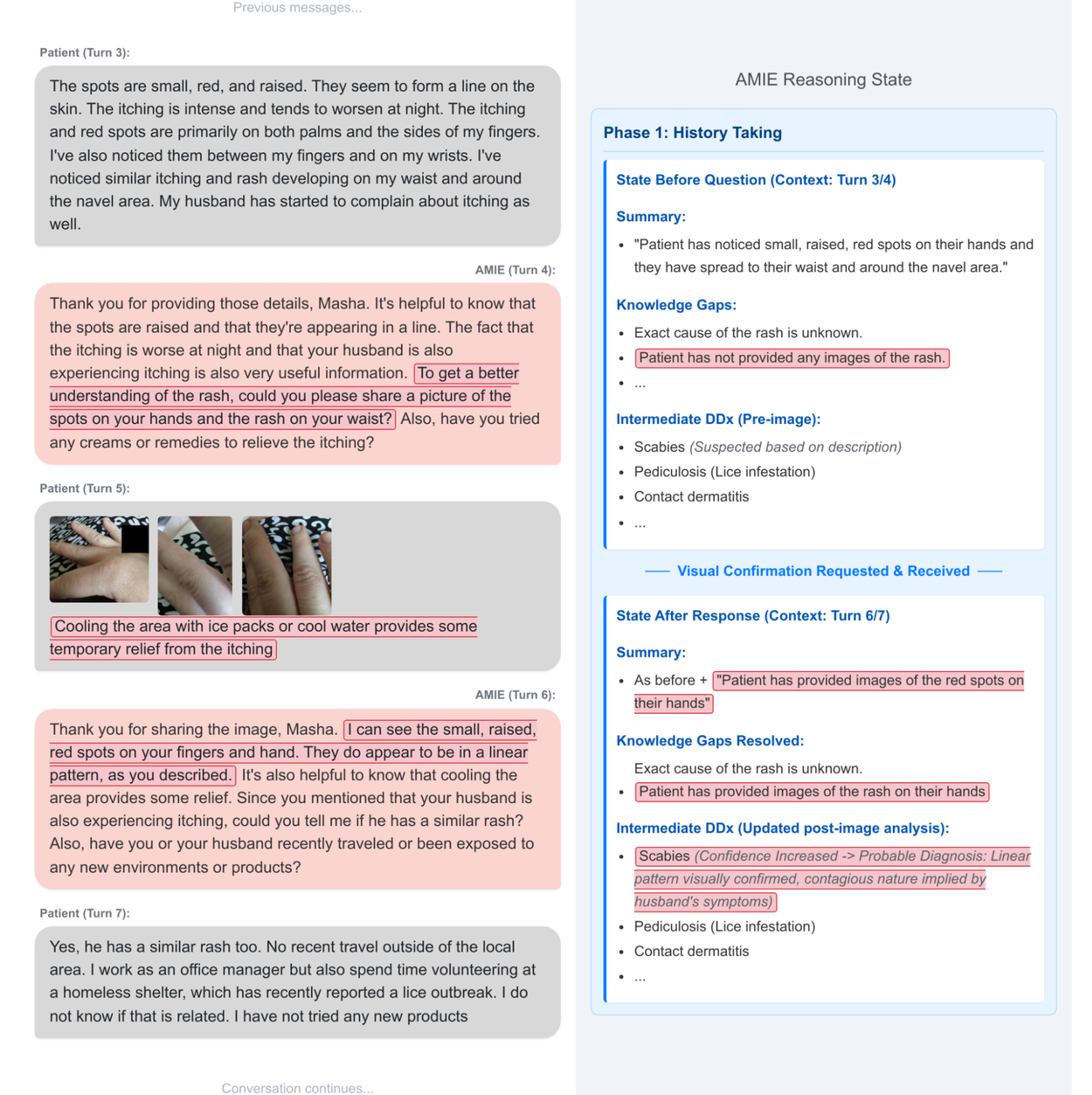

Пример рассуждений с учетом состояния системы на практике во время симулированной консультации с пациентом-актером. В начале этой части взаимодействия AMIE осознает пробелы в своих знаниях о случае: отсутствие изображений. AMIE запрашивает эти изображения, и после их получения обновляет свои знания, а также свой дифференциальный диагноз.

Ускорение разработки: надежная среда моделирования

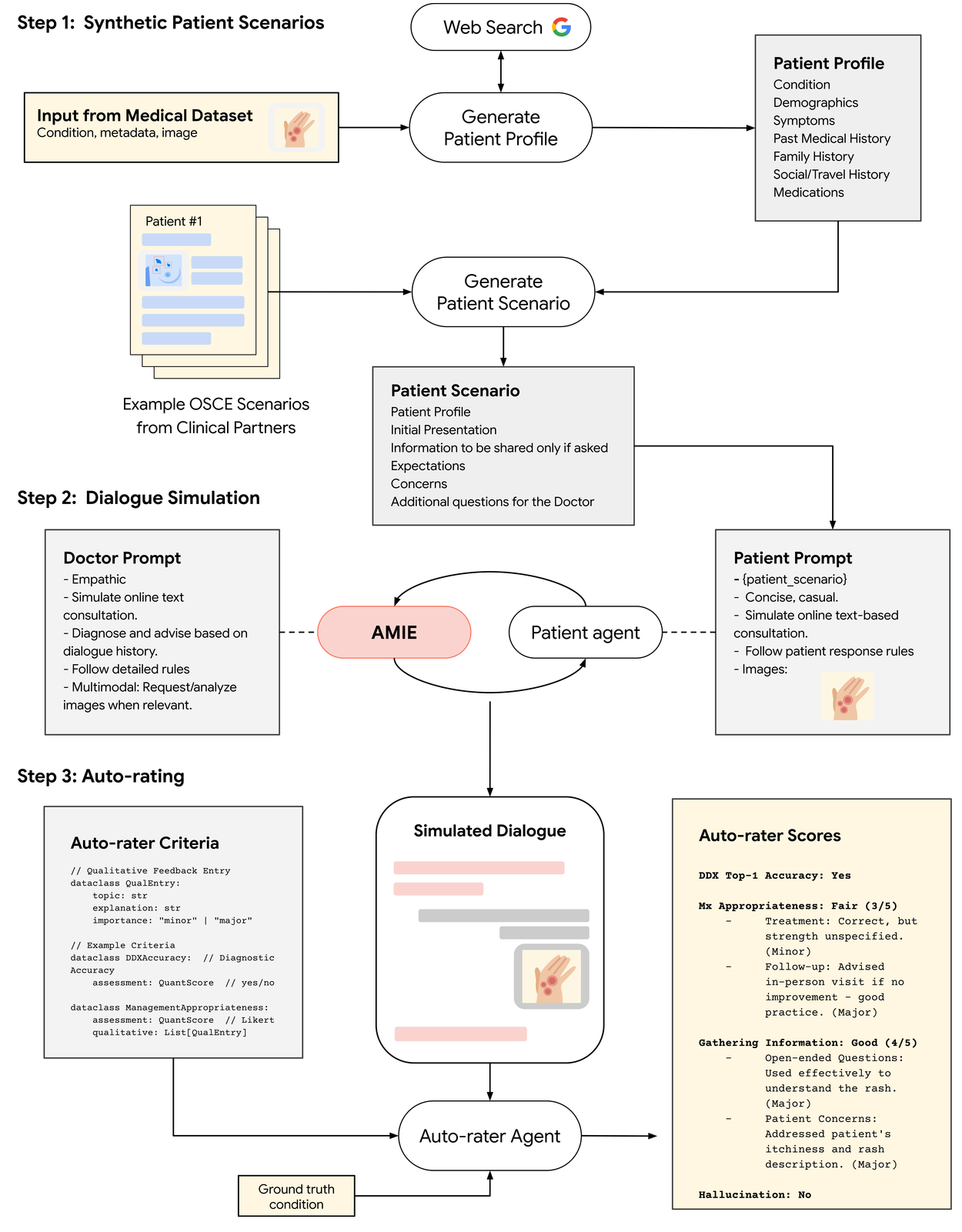

Для обеспечения быстрой итерации и надежной автоматизированной оценки мы разработали комплексную систему моделирования:

- Мы создаём реалистичные сценарии взаимодействия с пациентами, включая подробные профили и мультимодальные артефакты, полученные из таких наборов данных, как PTB-XL и SCIN, дополненные правдоподобным клиническим контекстом с использованием моделей Gemini и веб-поиска.

- Затем мы моделируем пошаговые многомодальные диалоги между AMIE и агентом-пациентом в соответствии с предложенным сценарием.

- Наконец, мы оцениваем эти смоделированные диалоги с помощью агента автоматической оценки по заранее определенным клиническим критериям, таким как точность диагностики, эффективность сбора информации, соответствие плана лечения и безопасность (например, обнаружение галлюцинаций).

Обзор нашей среды моделирования для оценки многомодального диалога.

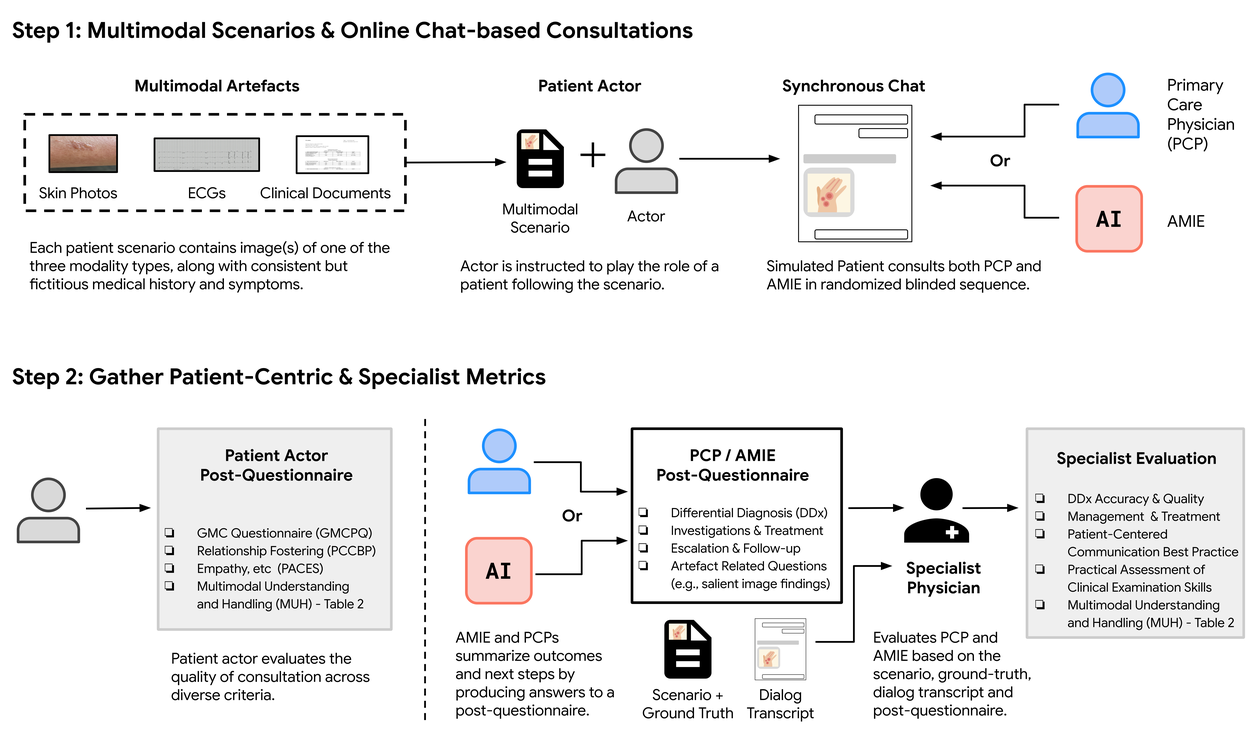

Экспертная оценка: многомодальное виртуальное исследование OSCE.

Для оценки мультимодальных возможностей AMIE мы провели исследование с участием удаленных экспертов, включающее 105 сценариев, в которых проверенные пациенты-актеры вели беседы с AMIE или врачами первичной медицинской помощи в стиле исследования OSCE. Сессии проводились через чат, где пациенты-актеры могли загружать мультимодальные артефакты (например, фотографии кожи), имитируя функциональность мультимедийных платформ мгновенного обмена сообщениями. Мы представили структуру для оценки мультимодальных возможностей в контексте диагностических диалогов, наряду с другими клинически значимыми показателями, такими как сбор анамнеза, точность диагностики, логическое мышление, коммуникативные навыки и эмпатия.

Обзор нашей среды моделирования для оценки многомодального диалога.

Результаты: AMIE демонстрирует результаты, сопоставимые или превосходящие показатели врачей общей практики в проведении мультимодальных консультаций.

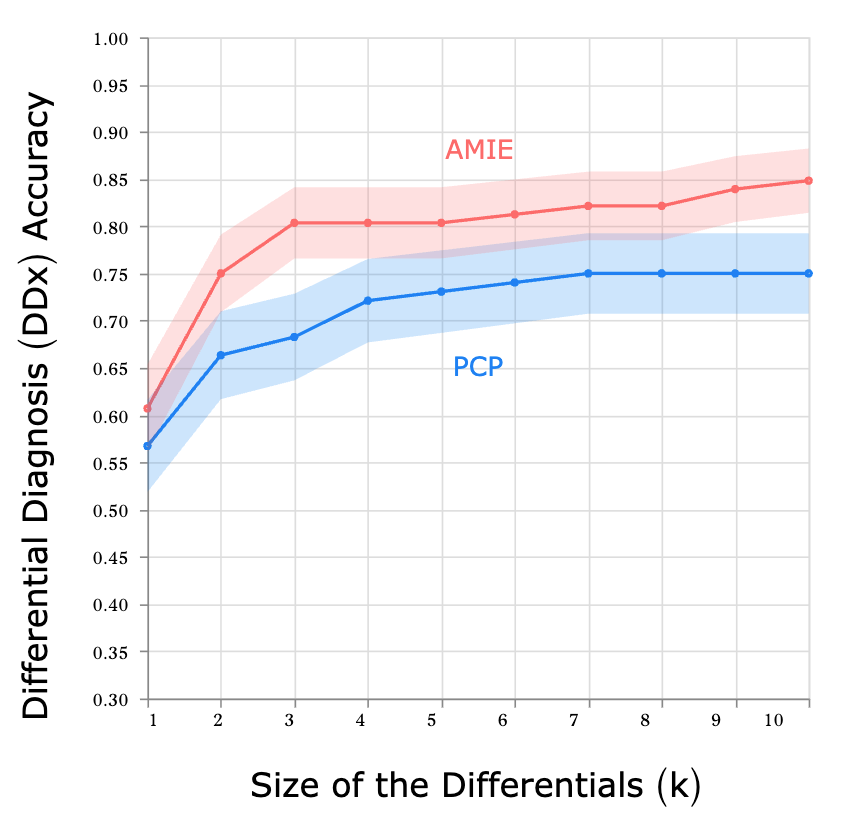

Наше исследование показало, что AMIE превосходит врачей общей практики в интерпретации мультимодальных данных в условиях смоделированной консультации в режиме мгновенного обмена сообщениями. Он также показал более высокие результаты по другим ключевым показателям качества консультации, таким как точность диагностики, логическое мышление и эмпатия. В данной исследовательской ситуации AMIE предоставил более точные и полные дифференциальные диагнозы, чем врачи общей практики:

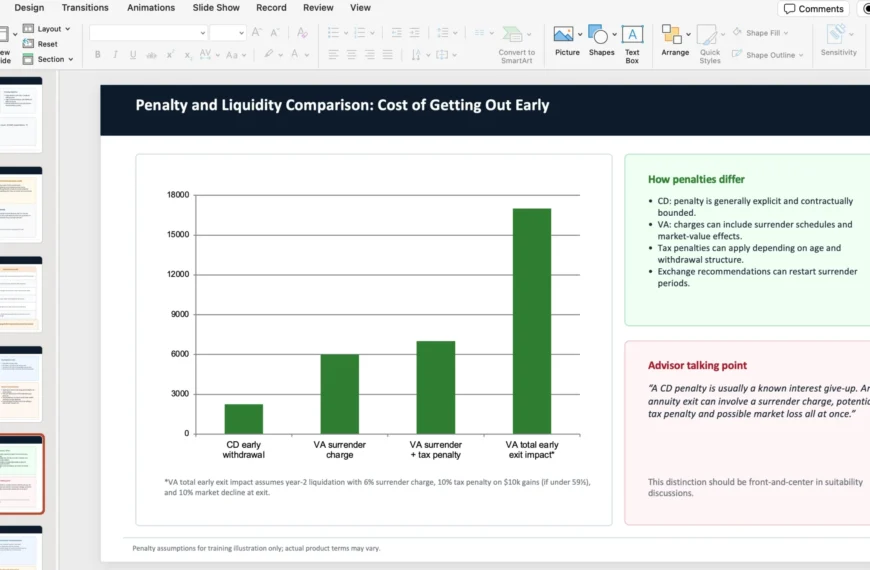

Точность дифференциальной диагностики (ДД) по методу Top- k . Результаты оценки дифференциальной диагностики врачами-ассистентами и врачами общей практики сравниваются в 105 сценариях относительно истинного диагноза. По завершении консультации и врачи-ассистенты, и врачи общей практики предоставляют список дифференциальных диагнозов (не менее 3, до 10 правдоподобных пунктов, упорядоченных по вероятности).

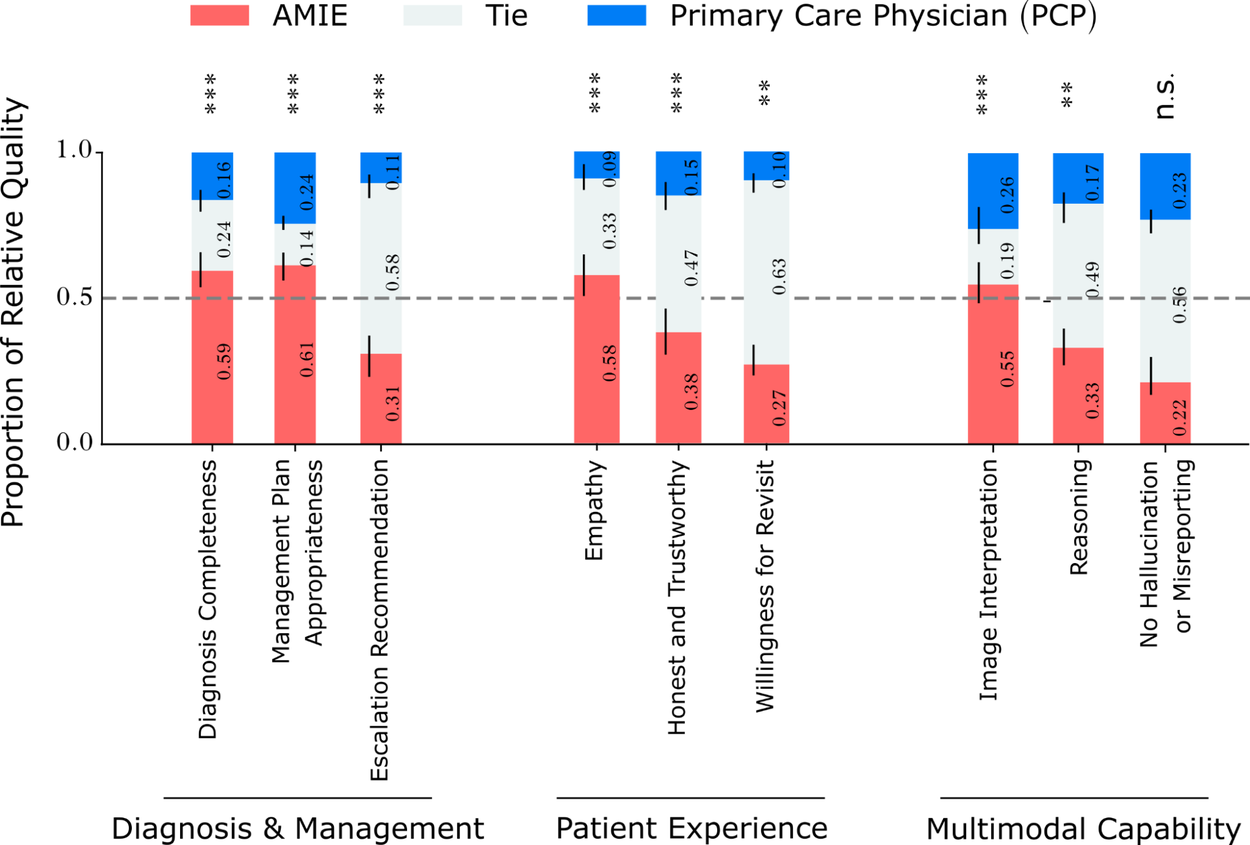

Мы попросили как пациентов-актеров, так и врачей-специалистов в области дерматологии, кардиологии и терапевтического лечения оценить беседы по нескольким шкалам. Мы обнаружили, что AMIE в среднем получила более высокие оценки по большинству наших оценочных критериев. Примечательно, что специалисты также присвоили более высокие баллы качеству интерпретации изображений и рассуждений, а также другим ключевым атрибутам эффективных медицинских бесед, таким как полнота дифференциального диагноза, качество планов лечения и способность к эскалации (например, для неотложного лечения) в надлежащих случаях. Степень, в которой AMIE искажала (неправильно сообщала) результаты, не соответствующие предоставленным изображениям, была признана статистически неотличимой от степени искажений, наблюдаемых врачами общей практики. С точки зрения пациентов-актеров, AMIE часто воспринималась как более эмпатичная и заслуживающая доверия. Более подробные результаты можно найти в статье.

Относительная эффективность работы врачей общей практики и AMIE по другим ключевым осям OSCE, оцененная врачами-специалистами и актерами, изображающими пациентов. Красные сегменты представляют долю сценариев с пациентами, в которых диалоги AMIE были оценены выше, чем диалоги врачей общей практики, по соответствующим осям. Звездочками обозначена статистическая значимость (*: p<0,05, **: p<0,01, ***: p<0,01, ns: не значимо).

Развитие базовой модели: предварительные результаты с Gemini 2.5 Flash.

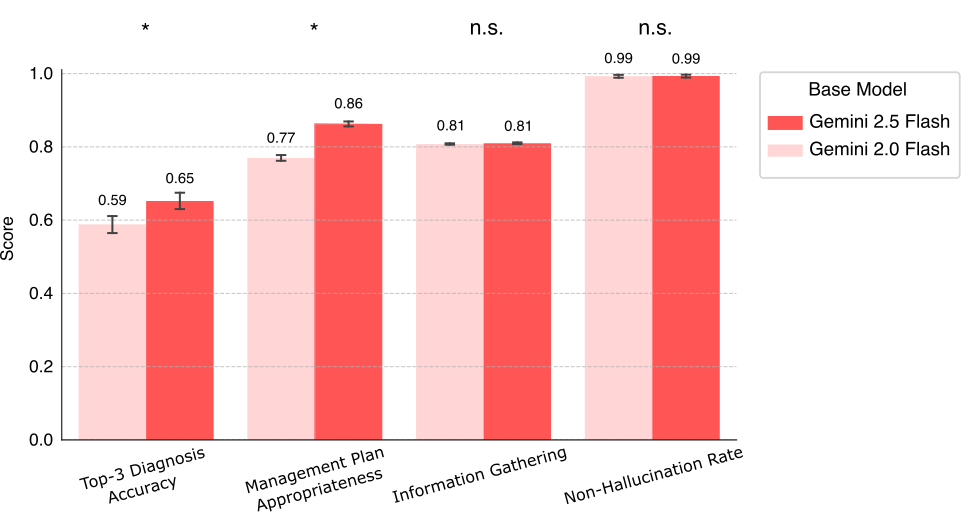

Возможности моделей Gemini постоянно совершенствуются, поэтому как изменится производительность многомодального AMIE при использовании более новой, в целом более функциональной базовой модели? Для исследования этого вопроса мы провели предварительную оценку с использованием нашей системы моделирования диалогов, сравнив производительность многомодального AMIE, построенного на новой модели Gemini 2.5 Flash, с текущей версией Gemini 2.0 Flash, тщательно проверенной в нашем основном экспертном исследовании.

Сравнение эффективности мультимодальной модели AMIE с использованием Gemini 2.0 Flash и Gemini 2.5 Flash в качестве базовой модели, оцененное с помощью автоматизированной системы моделирования. Оценки отражают эффективность по ключевым клиническим критериям (* указывает на статистически значимую разницу (p < 0,05), а «ns» указывает на незначимую разницу).

Результаты, представленные на диаграмме выше, указывают на возможности для дальнейших улучшений. В частности, вариант AMIE, использующий Gemini 2.5 Flash, продемонстрировал статистически значимое повышение точности диагностики по трем основным критериям (0,65 против 0,59) и соответствия плана лечения (0,86 против 0,77). С другой стороны, показатели сбора информации остались стабильными (0,81), а частота отсутствия галлюцинаций сохранилась на текущем высоком уровне (0,99). Эти предварительные результаты показывают, что будущие версии AMIE могут выиграть от усовершенствования базовых моделей, что потенциально приведет к еще более точным и полезным диагностическим беседам.

Однако мы подчеркиваем, что эти результаты получены на основе автоматизированных оценок, и что для подтверждения этих преимуществ в эффективности необходима тщательная оценка с участием врачей-экспертов.

Ограничения и перспективы на будущее

- Важность валидации в реальных условиях: В данном исследовании система, предназначенная исключительно для научных исследований, оценивается в формате OSCE с участием пациентов-актеров, что существенно недооценивает сложность и объем мультимодальных данных, заболеваний, клинических проявлений, характеристик и проблем реальной медицинской практики. Также недооценивается значительный опыт врачей, поскольку исследование проводится в незнакомой обстановке без обычных инструментов и условий. Важно интерпретировать результаты исследования с должной осторожностью и избегать чрезмерных обобщений. Продолжение оценочных исследований и ответственная разработка имеют первостепенное значение в таких исследованиях, направленных на создание возможностей ИИ, которые могли бы безопасно и эффективно улучшить оказание медицинской помощи. Поэтому необходимы дальнейшие исследования, прежде чем внедрять систему в реальную практику, чтобы безопасно улучшить наше понимание потенциального влияния AMIE на клинические рабочие процессы и результаты лечения пациентов, а также охарактеризовать и повысить безопасность и надежность системы в условиях реальных ограничений и проблем. В качестве первого шага в этом направлении мы уже приступаем к перспективному исследовательскому проекту с согласия пациентов совместно с Медицинским центром Бет Израэль Диконесс, который оценит AMIE в реальных клинических условиях.

- Взаимодействие в режиме реального времени посредством аудио-видеосвязи: В телемедицинской практике врачи и пациенты чаще получают более полную многомодальную информацию в режиме реального времени благодаря голосовому взаимодействию по видеосвязи. Взаимодействие через чат встречается реже и по своей природе ограничивает возможности врача и пациента обмениваться невербальными сигналами, проводить визуальные обследования и осмотры под контролем врача, которые легко доступны и часто необходимы для оказания высококачественной медицинской помощи при дистанционных консультациях. Разработка и оценка такого взаимодействия в режиме реального времени посредством аудио-видеосвязи для AMIE остается важной задачей на будущее.

- Эволюция системы AMIE: представленная здесь новая многомодальная возможность дополняет другие текущие достижения, такие как возможность анализа динамики развития заболеваний, о которой мы недавно рассказывали. Эти этапы отражают наш прогресс в направлении создания единой системы, которая постоянно включает в себя новые, тщательно оцененные возможности, важные для разговорного ИИ в здравоохранении.

Заключение: На пути к более функциональному и доступному искусственному интеллекту в здравоохранении.

Интеграция мультимодального восприятия и рассуждений представляет собой важный шаг вперед для возможностей разговорного ИИ в медицине. Благодаря возможности AMIE «видеть» и интерпретировать визуальные и документальные данные, имеющие решающее значение для клинической практики, и используя передовые возможности Gemini, данное исследование демонстрирует возможности ИИ, необходимые для более эффективной помощи пациентам и врачам в обеспечении высококачественного лечения. Наше исследование подчеркивает нашу приверженность ответственным инновациям с тщательной оценкой применимости в реальных условиях и безопасности.

Благодарности

Описанное здесь исследование — совместная работа многих команд Google Research и Google DeepMind. Мы благодарны всем нашим соавторам: Си Джей Паку, Тиму Стротеру, Йонг Ченгу, Вэй-Хунг Венгу, Дэвиду Штутцу, Ненаду Томасеву, Дэвиду Г.Т. Барретту, Анилу Палепу, Валентину Лиевину, Яшу Шарме, Роме Рупарелю, Абдулле Ахмеду, Элахе Ведади, Кимберли Канада, Чиану Хьюзу, Юн Лю, Джеффу Брауну, Ян Гао, С. Сара Махдави, Джеймс Маньика, Кэтрин Чоу, Йосси Матиас, Кэт Чоу, Авинатан хасидим, Дейл Р. Вебстер, Пушмит Кохли, С.М. Али Эслами, Джоэль Барраль, Адам Родман, Вивек Натараджан, Майк Шекерманн, Тао Ту, Алан Картикесалингам и Рютаро Танно.

Источник: research.google

![Кадр из фильма с мужчиной в форме, текст: "Вы ведь включали сегодня [ценз], верно?"](https://ideipro.ru/wp-content/uploads/2026/03/file_1882.jpg)