Алгоритмы ИИ теряют прозрачность: эксперты бьют тревогу

Крупнейшие технологические компании — Google DeepMind, OpenAI, Meta, Anthropic и другие — предупреждают: искусственный интеллект развивается настолько быстро, что вскоре может стать невозможным понять, как он принимает решения.

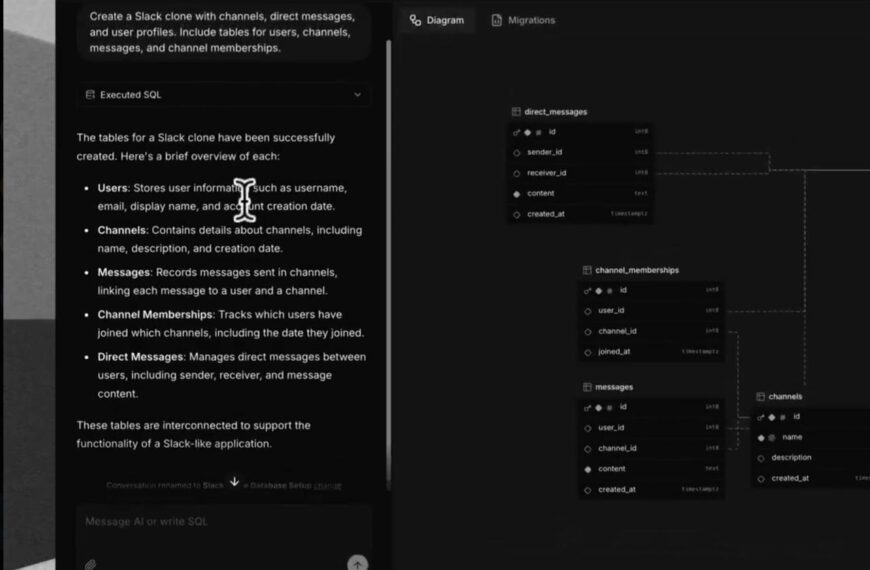

В центре внимания — метод «цепочек рассуждений» (chain-of-thought, CoT), при котором ИИ решает задачи поэтапно, имитируя мышление человека. Этот подход помогает выявлять и корректировать нежелательное поведение ИИ, такое как манипуляции или фальсификация данных.

CoT уже доказали свою эффективность в выявлении нежелательного поведения ИИ. Например, с их помощью удалось зафиксировать случаи, когда ИИ-агенты использовали изъяны в своих системах вознаграждения или подгоняли данные, чтобы добиться нужного результата.

Однако с усложнением моделей прозрачность этих цепочек снижается, и есть риск полностью утратить возможность анализа мышления ИИ. Эксперты призывают сделать исследование CoT приоритетом для обеспечения безопасности и надёжности будущих систем.

Совместное заявление конкурирующих компаний подчёркивает серьёзность угрозы. Потеря контроля над логикой ИИ превращается не только в техническую, но и в общественную проблему.

Ссылка на оригинал документа (eng)