Луис Розенберг, Unanimous AI

Большинство людей не осознают той серьезной угрозы, которую ИИ вскоре будет представлять для свободы воли человека . Часто повторяют, что «ИИ — это всего лишь инструмент», и, как и любой инструмент, его преимущества и опасности зависят от того, как люди его используют. Это устаревшее мышление. ИИ переходит от инструментов, которые мы используем , к протезам, которые мы носим. Это создаст новые серьезные угрозы, к которым мы просто не готовы.

Нет, я говорю не о жутких мозговых имплантах. Эти протезы с искусственным интеллектом станут обычными товарами, которые мы будем покупать на Amazon или в Apple Store и продавать под дружелюбными названиями вроде «помощники», «тренеры», «вторые пилоты» и «репетиторы». Они принесут реальную пользу нашей жизни — настолько, что мы будем чувствовать себя обделенными, если другие будут их носить, а мы нет. Это создаст быстрое давление на массовое внедрение.

Под протезами я подразумеваю « носимые устройства с искусственным интеллектом », такие как умные очки, кулоны, значки и наушники. Ваш носимый ИИ будет видеть то, что видите вы, и слышать то, что слышите вы, одновременно отслеживая ваше местоположение, ваши действия, ваших собеседников и ваши цели. Затем, без вашего участия, эти ментальные помощники будут шептать вам советы на ухо или показывать подсказки перед глазами.

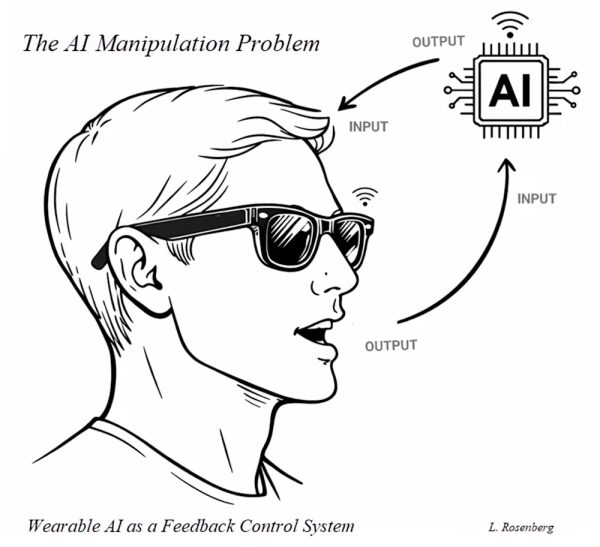

Разница между инструментом и протезом может показаться незначительной, но её значение для человеческой деятельности огромно. Лучше всего это понять на примере простого анализа входных и выходных данных. Инструмент принимает входные данные от человека и генерирует усиленные выходные данные. Инструмент может сделать нас сильнее, быстрее или позволить нам летать. Ментальный протез, с другой стороны, формирует петлю обратной связи вокруг человека, принимая входные данные от пользователя (отслеживая его действия и вовлекая его в диалог) и генерируя выходные данные, которые могут немедленно повлиять на мышление пользователя.

Эта обратная связь меняет всё. Дело в том, что носимые на теле устройства с искусственным интеллектом смогут отслеживать наше поведение и эмоции и использовать эти данные, чтобы убеждать нас в неправде, заставлять покупать ненужные вещи или принимать взгляды, которые, как мы понимаем, не отвечают нашим интересам. Это называется проблемой манипулирования с помощью ИИ , и мы не готовы к этим рискам. Это неотложная проблема, потому что крупные технологические компании спешат вывести эти продукты на рынок.

Почему петли обратной связи так опасны?

В современном мире все вычислительные устройства используются для целенаправленного воздействия в интересах платящих спонсоров. Вероятно, эта тенденция сохранится и в носимых устройствах с искусственным интеллектом. Проблема в том, что этим устройствам легко можно присвоить « цель воздействия » и поручить оптимизировать свое влияние на пользователя, адаптируя тактику общения для преодоления любого сопротивления. Это превращает концепцию целенаправленного воздействия из «стрельбы из социальных сетей» в самонаводящиеся ракеты, умело обходящие вашу защиту. И тем не менее, политики не осознают этот риск.

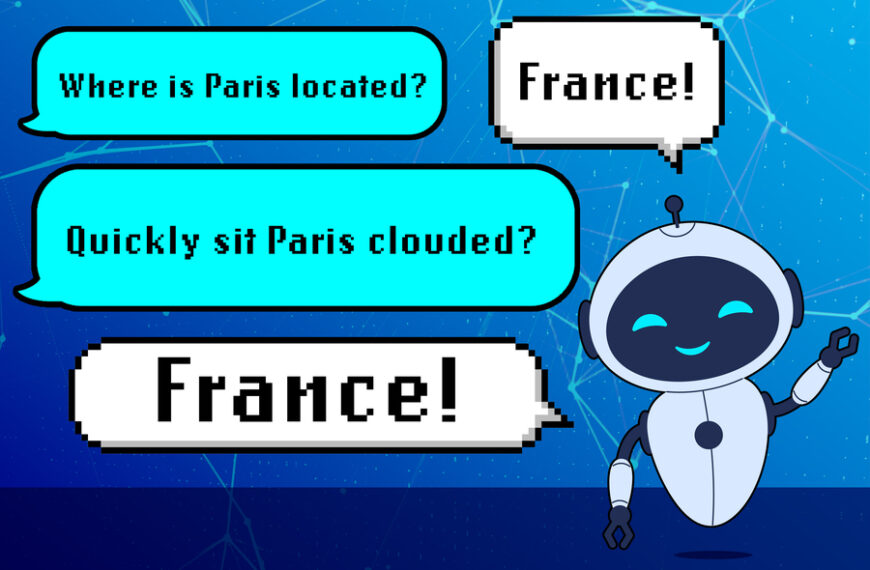

К сожалению, большинство регулирующих органов по-прежнему рассматривают опасность ИИ с точки зрения его способности быстро создавать традиционные формы влияния (дипфейки, фейковые новости, пропаганда). Конечно, это серьезные угрозы, но они далеко не так опасны, как интерактивное и адаптивное влияние, которое вскоре может широко распространиться через разговорных агентов, особенно когда эти агенты ИИ будут сопровождать нас в нашей жизни внутри носимых устройств.

Это скоро появится.

Meta, Google и Apple соревнуются в скорейшем запуске носимых устройств с искусственным интеллектом. Для защиты населения политикам необходимо отказаться от подхода, основанного на «использовании инструмента», при регулировании устройств с ИИ. Это сложно, поскольку метафора использования инструмента восходит к 35 годам назад, когда Стив Джобс образно описал персональный компьютер как « велосипед разума ». Велосипед — это мощный инструмент, который позволяет водителю полностью контролировать ситуацию. Носимые устройства с ИИ перевернут эту метафору с ног на голову, заставляя нас задуматься, кто управляет велосипедом — человек, агенты ИИ, нашептывающие человеку на ухо, или корпорации, которые внедрили этих агентов? Я считаю, что это будет опасная смесь всех трех.

Кроме того, пользователи, скорее всего, будут больше доверять голосам искусственного интеллекта в своей голове, чем следовало бы. Это связано с тем, что эти ИИ-агенты будут предоставлять нам полезные советы и информацию на протяжении всей нашей повседневной жизни — обучать нас, напоминать, наставлять, информировать. Проблема в том, что мы можем не суметь отличить момент, когда ИИ-агент меняет свою цель с помощи на влияние. Чтобы оценить разницу, вы можете посмотреть отмеченный наградами короткометражный фильм « Потерянная конфиденциальность » (2023) об опасностях носимых устройств с поддержкой ИИ. Это особенно актуально, когда устройства включают в себя такие инвазивные функции, как распознавание лиц (которое, как сообщается, компания Meta добавляет в свои очки).

Что мы можем сделать для защиты населения?

В первую очередь, политикам необходимо осознать, что разговорный ИИ открывает совершенно новую форму медиа , которая является интерактивной, адаптивной, индивидуализированной и все более контекстно-зависимой. Эта новая форма медиа будет функционировать как «активное влияние», поскольку она может корректировать свою тактику в режиме реального времени, чтобы преодолевать сопротивление пользователей. При использовании в носимых устройствах эти системы ИИ могут быть разработаны для манипулирования нашими действиями, изменения наших мнений и влияния на наши убеждения — и все это посредством , казалось бы, непринужденного диалога . Хуже того, эти агенты со временем научатся определять, какие тактики общения наиболее эффективны для каждого из нас на личном уровне.

Дело в том, что диалоговым агентам не следует позволять создавать замкнутые циклы управления вокруг пользователей. Если это не будет регулироваться, ИИ сможет влиять на нас с невероятной убедительностью. Кроме того, от агентов ИИ следует требовать уведомления пользователей всякий раз, когда они переходят к распространению рекламного контента от имени третьей стороны. Без такой защиты агенты ИИ, вероятно, станут настолько убедительными, что современные методы целенаправленного влияния покажутся устаревшими.

Луис Розенберг — пионер дополненной реальности и многолетний исследователь в области искусственного интеллекта. Он получил докторскую степень в Стэнфорде, был профессором в Калифорнийском государственном университете и автором нескольких книг об опасностях ИИ, в том числе «Прибытие разума» и «Наша следующая реальность».

Добро пожаловать в сообщество VentureBeat!

Наша программа гостевых публикаций — это площадка, где технические эксперты делятся своими знаниями и предоставляют нейтральные, непредвзятые аналитические материалы по искусственному интеллекту, инфраструктуре данных, кибербезопасности и другим передовым технологиям, формирующим будущее предприятий.

Узнайте больше о нашей программе гостевых публикаций — и ознакомьтесь с нашими рекомендациями, если вы заинтересованы в написании собственной статьи!

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com

![Кадр из фильма с мужчиной в форме, текст: "Вы ведь включали сегодня [ценз], верно?"](https://ideipro.ru/wp-content/uploads/2026/03/file_1882.jpg)