Создавайте агентов ИИ мгновенно с помощью 5 готовых к запуску контейнеров Docker. Загружайте, запускайте и начинайте создавать без какой-либо настройки.

Изображение предоставлено автором.

# Введение

Появление таких фреймворков, как LangChain и CrewAI, упростило создание агентов искусственного интеллекта как никогда раньше. Однако разработка таких агентов часто сопряжена с ограничениями скорости запросов к API, управлением многомерными данными или подключением локальных серверов к интернету.

Вместо того чтобы платить за облачные сервисы на этапе прототипирования или засорять свою хост-машину зависимостями, вы можете использовать Docker . С помощью одной команды вы можете развернуть инфраструктуру, которая сделает ваши агенты умнее.

Вот 5 основных контейнеров Docker, которые должны быть в арсенале каждого разработчика ИИ-агентов.

# 1. Ollama: Запуск локальных языковых моделей

Панель управления Ollama

При создании агентов отправка каждого запроса облачному провайдеру, такому как OpenAI, может оказаться дорогостоящей и медленной. Иногда для решения конкретных задач, таких как исправление грамматики или классификация, требуется быстрая, частная модель.

Ollama позволяет запускать большие языковые модели с открытым исходным кодом (LLM) — такие как Llama 3 , Mistral или Phi — непосредственно на локальном компьютере. Запуская их в контейнере, вы поддерживаете чистоту системы и можете легко переключаться между различными моделями без сложной настройки среды Python.

Конфиденциальность и стоимость являются основными проблемами при создании агентов. Образ Docker Ollama упрощает запуск таких моделей, как Llama 3 или Mistral, через REST API.

// Объяснение, почему это важно для разработчиков Agentic

Вместо отправки конфиденциальных данных во внешние API, такие как OpenAI, вы можете предоставить своему агенту «мозг», который будет работать внутри вашей собственной инфраструктуры. Это важно для корпоративных агентов, работающих с конфиденциальными данными. Запустив команду `docker run ollama/ollama`, вы сразу получите локальную конечную точку, к которой код вашего агента сможет обращаться для генерации текста или анализа задач.

// Запуск быстрого старта

Для загрузки и запуска модели Mistral через контейнер Ollama используйте следующую команду. Это сопоставит порт и сохранит модели на вашем локальном диске.

docker run -d -v ollama:/root/.ollama -p 11434:11434 —name ollama ollama/ollama

После запуска контейнера необходимо загрузить модель, выполнив команду внутри контейнера:

docker exec -it ollama ollama run mistral

// Объяснение, почему это полезно для разработчиков Agentic

Теперь вы можете указать клиенту LLM вашего агента адрес http://localhost:11434. Это обеспечит вам локальную, совместимую с API конечную точку для быстрого прототипирования и гарантирует, что ваши данные никогда не покинут ваш компьютер.

// Обзор основных преимуществ

- Конфиденциальность данных: Обеспечьте безопасность ваших запросов и данных.

- Экономическая эффективность: отсутствие платы за использование API для вывода результатов.

- Задержка: Более быстрая реакция при работе на локальных графических процессорах.

Узнайте больше: Ollama Docker Hub

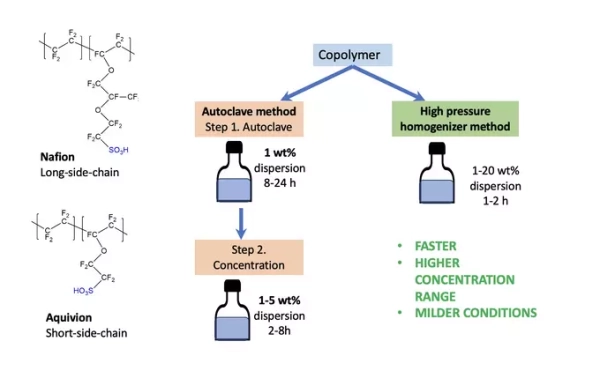

# 2. Qdrant: Векторная база данных для памяти

Панель мониторинга Qdrant

Агентам необходима память для воспроизведения прошлых разговоров и знаний в предметной области. Для обеспечения долговременной памяти агенту требуется векторная база данных . Эти базы данных хранят числовые представления (встраивания) текста, позволяя агенту в дальнейшем искать семантически схожую информацию.

Qdrant — это высокопроизводительная векторная база данных с открытым исходным кодом, написанная на Rust. Она быстрая, надежная и предлагает как gRPC , так и REST API. Запуск в Docker мгновенно предоставляет вам систему памяти производственного уровня для ваших агентов.

// Объяснение, почему это важно для разработчиков Agentic

Для создания агента генерации с расширенными возможностями поиска (RAG) необходимо хранить векторные представления документов и быстро их извлекать. Qdrant выступает в качестве долговременной памяти агента. Когда пользователь задает вопрос, агент преобразует его в вектор, ищет в Qdrant похожие векторы, представляющие релевантные знания, и использует этот контекст для формулирования ответа. Запуск в Docker обеспечивает независимость этого уровня памяти от кода приложения, что делает его более надежным.

// Запуск быстрого старта

Запустить Qdrant можно одной командой. Это откроет доступ к API и панели мониторинга на порту 6333, а также к интерфейсу gRPC на порту 6334.

docker run -d -p 6333:6333 -p 6334:6334 qdrant/qdrant

После выполнения этой команды вы можете подключить своего агента к localhost:6333. Когда агент узнает что-то новое, сохраните это встраивание в Qdrant. В следующий раз, когда пользователь задаст вопрос, агент сможет выполнить поиск в этой базе данных соответствующих «воспоминаний», чтобы включить их в запрос, сделав его по-настоящему диалоговым.

# 3. n8n: Объединение рабочих процессов

панель управления n8n

Рабочие процессы агентов редко существуют в вакууме. Иногда вам нужно, чтобы ваш агент проверил вашу электронную почту, обновил строку в таблице Google Sheets или отправил сообщение в Slack. Хотя вы могли бы писать вызовы API вручную, этот процесс часто бывает утомительным.

n8n — это инструмент автоматизации рабочих процессов, основанный на принципе честного кода. Он позволяет подключать различные сервисы с помощью визуального пользовательского интерфейса. Запустив его локально, вы можете создавать сложные рабочие процессы — например, «Если агент обнаруживает потенциального клиента, добавить его в HubSpot и отправить оповещение в Slack» — без написания единой строки кода интеграции.

// Запуск быстрого старта

Для сохранения рабочих процессов необходимо смонтировать том. Следующая команда настраивает n8n с использованием SQLite в качестве базы данных.

docker run -d —name n8n -p 5678:5678 -v n8n_data:/home/node/.n8n n8nio/n8n

// Объяснение, почему это полезно для разработчиков Agentic

Вы можете настроить свой агент так, чтобы он вызывал URL-адрес веб-перехватчика n8n. Агент просто отправляет данные, а n8n обрабатывает сложную логику взаимодействия с API сторонних разработчиков. Это разделяет «мозг» (LLM) и «руки» (интеграции).

Откройте редактор по адресу http://localhost:5678 и начните автоматизацию.

Узнайте больше: n8n Docker Hub

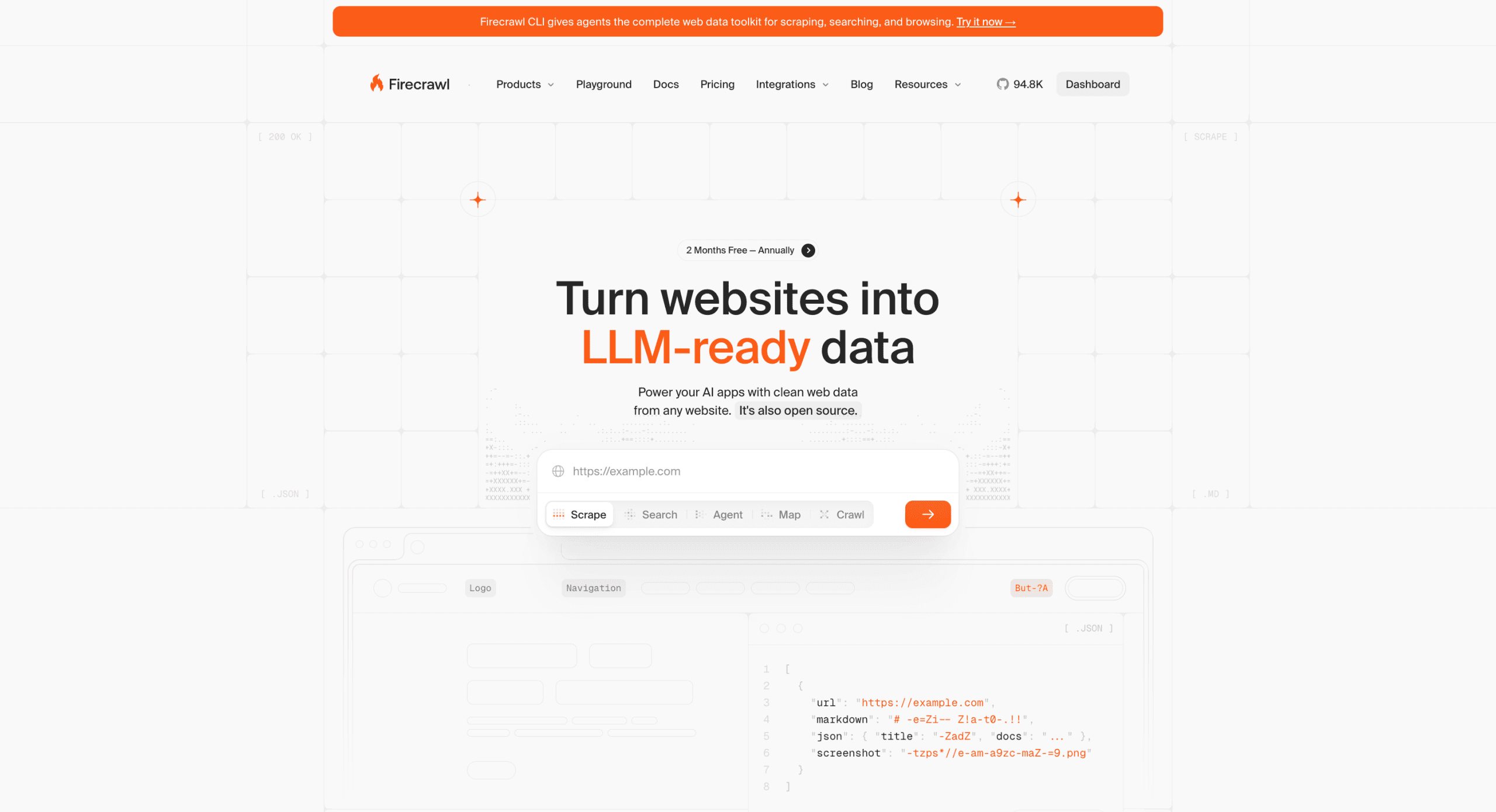

# 4. Firecrawl: Преобразование веб-сайтов в большие массивы данных, готовые для языковой модели.

Панель управления Firecrawl

Одна из самых распространенных задач для агентов — это исследование. Однако агентам сложно читать необработанный HTML-код или веб-сайты, созданные с помощью JavaScript. Им нужен чистый текст в формате Markdown.

Firecrawl — это API-сервис, который принимает URL-адрес, сканирует веб-сайт и преобразует контент в чистый Markdown или структурированные данные. Он обрабатывает рендеринг JavaScript и автоматически удаляет ненужный контент, такой как реклама и панели навигации. Запуск локально позволяет обойти ограничения облачной версии.

// Запуск быстрого старта

Firecrawl использует файл docker-compose.yml, поскольку состоит из нескольких сервисов, включая приложение, Redis и Playwright. Клонируйте репозиторий и запустите его.

git clone https://github.com/mendableai/firecrawl.git cd firecrawl docker compose up

// Объяснение, почему это полезно для разработчиков Agentic

Предоставьте своему агенту возможность получать веб-данные в режиме реального времени. Если вы создаете исследовательского агента, вы можете настроить его так, чтобы он обращался к вашему локальному экземпляру Firecrawl для загрузки веб-страницы, преобразования ее в чистый текст, разбиения на фрагменты и автономного сохранения в вашем экземпляре Qdrant.

# 5. PostgreSQL и pgvector: Реализация реляционной памяти

Панель мониторинга PostgreSQL

Иногда одного векторного поиска недостаточно. Вам может понадобиться база данных, способная одновременно обрабатывать структурированные данные — такие как профили пользователей или журналы транзакций — и векторные представления. PostgreSQL с расширением pgvector позволяет это сделать.

Вместо того чтобы использовать отдельную векторную базу данных и отдельную базу данных SQL, вы получаете преимущества обоих подходов. Вы можете хранить имя и возраст пользователя в столбце таблицы, а векторные представления его переписки — в другом столбце, а затем выполнять гибридные поиски (например, «Найти переписку пользователей из Нью-Йорка о возврате средств»).

// Запуск быстрого старта

Официальный образ PostgreSQL по умолчанию не включает pgvector. Вам необходимо использовать специальный образ, например, тот, который предоставляет организация pgvector.

docker run -d —name postgres-pgvector -p 5432:5432 -e POSTGRES_PASSWORD=mysecretpassword pgvector/pgvector:pg16

// Объяснение, почему это полезно для разработчиков Agentic

Это идеальная серверная часть для агентов, сохраняющих состояние. Ваш агент может записывать свои данные и внутреннее состояние в ту же базу данных, где хранятся данные вашего приложения, обеспечивая согласованность и упрощая архитектуру.

# Завершение

Для создания сложных агентов искусственного интеллекта не требуется огромный бюджет на облачные сервисы. Экосистема Docker предоставляет альтернативы производственного уровня, которые отлично работают на ноутбуке разработчика.

Добавив эти пять контейнеров в свой рабочий процесс, вы получаете следующее:

- Brains: Ollama для локального вывода

- Память: Qdrant для векторного поиска

- Hands: n8n для автоматизации рабочих процессов

- Глаза: Огненный ползунок для поглощения паутины

- Хранение данных: PostgreSQL с pgvector для структурированных данных.

Запустите контейнеры, направьте свой код LangChain или CrewAI на localhost и наблюдайте, как оживают ваши агенты.

// Дополнительная литература

- Ollama Docker Hub

- Документация Qdrant

- Документация n8n

- Firecrawl GitHub

- pgvector GitHub

Шитту Олумиде — инженер-программист и технический писатель, увлеченный использованием передовых технологий для создания захватывающих повествований, обладающий острым вниманием к деталям и умением упрощать сложные концепты. Шитту также можно найти в Твиттере.

Источник: www.kdnuggets.com